2,420円 (税込)

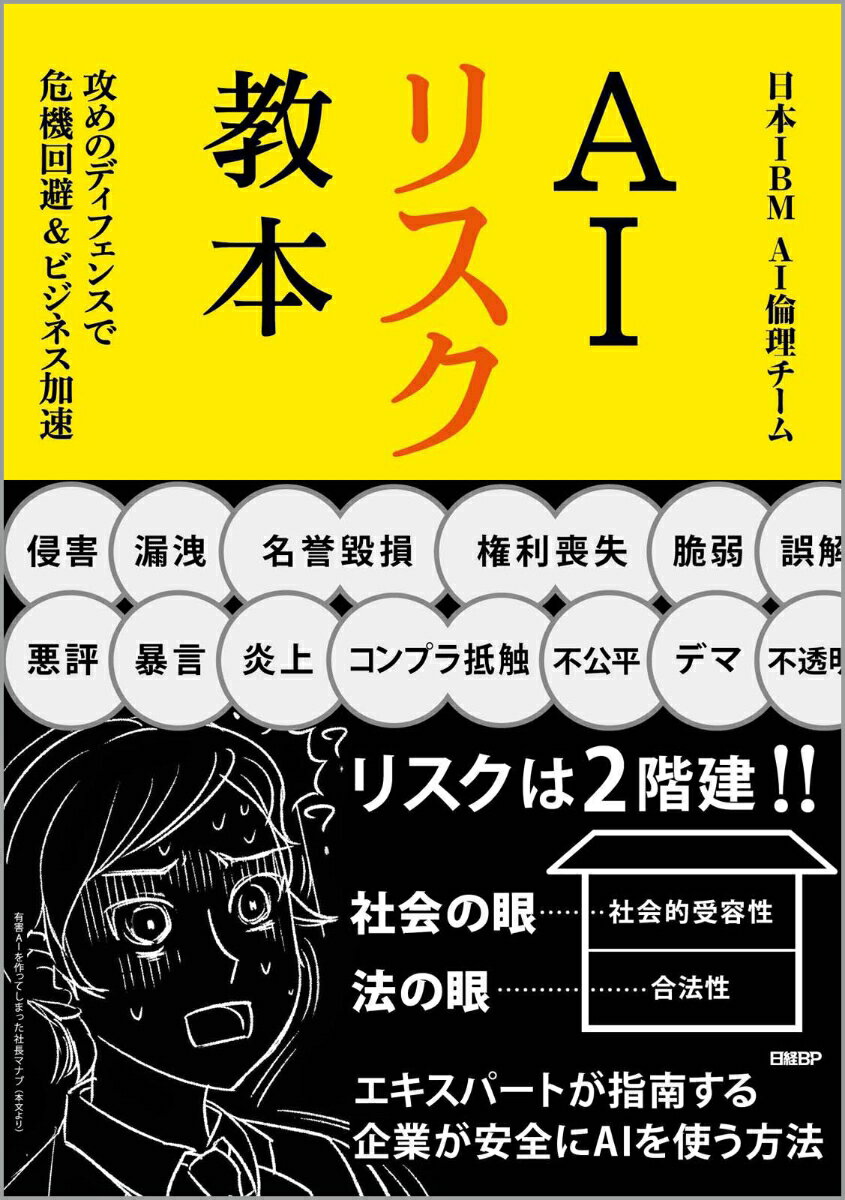

楽天AIリスク教本

書籍情報

発売日:

著者/編集:日本IBM AI倫理チーム

出版社:日経BP

発行形態:単行本

ページ数:272ページ

書籍説明

内容紹介

AI活用を企業が安全に推進できる「ガードレール」の引き方を解説 AI(人工知能)の技術が発展し、精度が高まり、導入の機運が高まるのと比例して、AIリスクの問題も増え、大きくなっています。本書は「企業としてAIをどんどん使っていきたい。でもリスクが心配だ。どう対処すればよいのか知りたい」という読者の疑問に答えます。AIにどのようなリスクがあり、それにどのような対策を講じるべきかを具体的に整理しました。■5つの仮想ストーリーでリスクを体感 AIリスクへの対策を怠ると何が起きるのか。企業がAIリスクに晒されるシナリオを、5つの架空の物語でわかりやすくお伝えします。そういったAIリスクがなぜ生じるのか、リスクの発生メカニズムと技術進歩の関係を整理しました(1章&2章)■AIリスクを17に分類、現実的な対策を解説 典型的なAIリスクを17に分類、それぞれへの対策を具体的な事例を交えながら解説します。AIに関わる立場と開発プロセスの段階別に対策を提示。それぞれのステップでリスク管理や低減に役立つツールの使い方も併せて解説しました(3章&4章)■「EU AI規則案」を解説、日本と世界のAI規制を把握 2023年6月14日に欧州議会により採択されたEU(欧州連合)の「AI規則案」の意味と影響を詳しく説明しました。加えて、EU以外の世界の動向や、国内のAI規制・ガイドラインの流れも解説しました(5章)■「AIガバナンス」の構築と運用の実際を解説 AIリスクを管理し、適切な対策を実践するためのリーダシップの仕組み「AIガバナンス」をどうやって構築・運用すればよいか。IBMと日本IBMの経験とノウハウを交えて、実践的に解説しました(6章) AIのリスクを正しく理解し、1つひとつ適切な対策を行えば、リスクを回避したり低減させたりしながらAIプロジェクトを前に進められます。正しい理解と適切な対処方法を身につけて、AIの大きな転換期を飛躍のチャンスにつなげるお手伝いをするのが本書の目的です。

目次

はじめに

本書の発行に寄せて

第1章 AIリスク仮想シナリオ:5つのストーリーで疑似体験

1.1 有害AIを作ってしまった社長マナブ

1.2 AIで論文が拒否された研究者ルカ

1.3 新技術をAIで流出させた開発担当マリナ

1.4 へーパイ・ドーグ社の暴言AIチャット

1.5 AIで人手不足が起きたタイムコンスト社

第2章 AIリスクはなぜ危険か:技術進化とリスク2階建て構造

2.1 なぜAIにリスクが生じるのか

2.2 AIリスクは2階建て、法と社会の眼が監視

2.3 AI基盤モデルはなぜ登場したのか

2.4 生成AIが生み出す新しいリスク

第3章 AIリスクはどう起きるか:基本5特性とリスク17分類

3.1 誰がAIの開発・運用・利用に責任を持つのか

3.2 「信頼できるAI」が備えるべき5つの基本特性

3.3 16+1種類のAIリスクを分類解説

解説コラム 著作権法第30条の4で認められた「情報解析」とは何か

第4章 AIリスク対策の現実解:ケース・技術・実施項目

4.1 9つのケースで理解するAIリスク対策

4.2 AIリスクの対策ソフトウエア

4.3 AI開発者が取るべき対策

4.4 AI導入者が取るべき対策

4.5 AI利用者が取るべき対策

第5章 AI規制・ガイドライン:世界と日本の最新動向

5.1 AI原則から規制・ガイドラインへ

解説コラム 「AI倫理問題」はそもそも存在するのか

5.2 ソフトローとハードロー、リスクベースアプローチ

5.3 初の国際的なAIハードロー「EU AI規則案」

5.4 「EU AI規則案」の思想としくみを解説

5.5 日本のAI規制・ガイドラインの動向

付録:EU AI規則案補足資料

第6章 企業を守るAIガバナンス:構築と運用の実践ガイド

6.1 「AIガバナンス」があなたの会社を守る

6.2 実践AIガバナンス:AI開発者・導入者編

6.3. 実践AIガバナンス:AI利用者編

おわりに

著者情報

日本IBM AI倫理チーム