【レポート】「AIは手書き文字を読めるの?はじめて触れるディープラーニング」

2019年8月21日「AIは手書き文字を読めるの?はじめて触れるディープラーニング」のレポートです。

TEQSセミナー担当の川合です。

テックスでは定番となりつつある早石直広さんによるAIセミナー。

今回はそのハンズオンシリーズの中で最も基礎となる内容でした。

ディープラーニングを使って、手書き文字を識別するのが今回のテーマ。

ディープラーニングによる画像認識は、ざっくり言うと、

例えば、イヌの画像ならイヌ、ネコの画像ならネコと、

正解となる「教師データ」を大量に用意して学習させ、

それを元にして、教えていない犬の画像や猫の画像を見せた時に

「それは犬です」「猫です」と判定させるもの。

セミナーでは教師データとして、ディープラーニング学習の定番である

「MNIST」という手書き数字のデータセットを使用しました。

・THE MNIST DATABASE

http://yann.lecun.com/exdb/mnist/

ディープラーニングの環境には、「Anaconda(アナコンダ)」という

Pythonの開発環境プラットフォームを利用して、そこにTensorFlowなど

必要なフレームワークやライブラリを設定しました。

・Anaconda

環境の設定からセミナーで教えていただけたので、

自宅に帰っても同じ環境を作って復習できそうです。

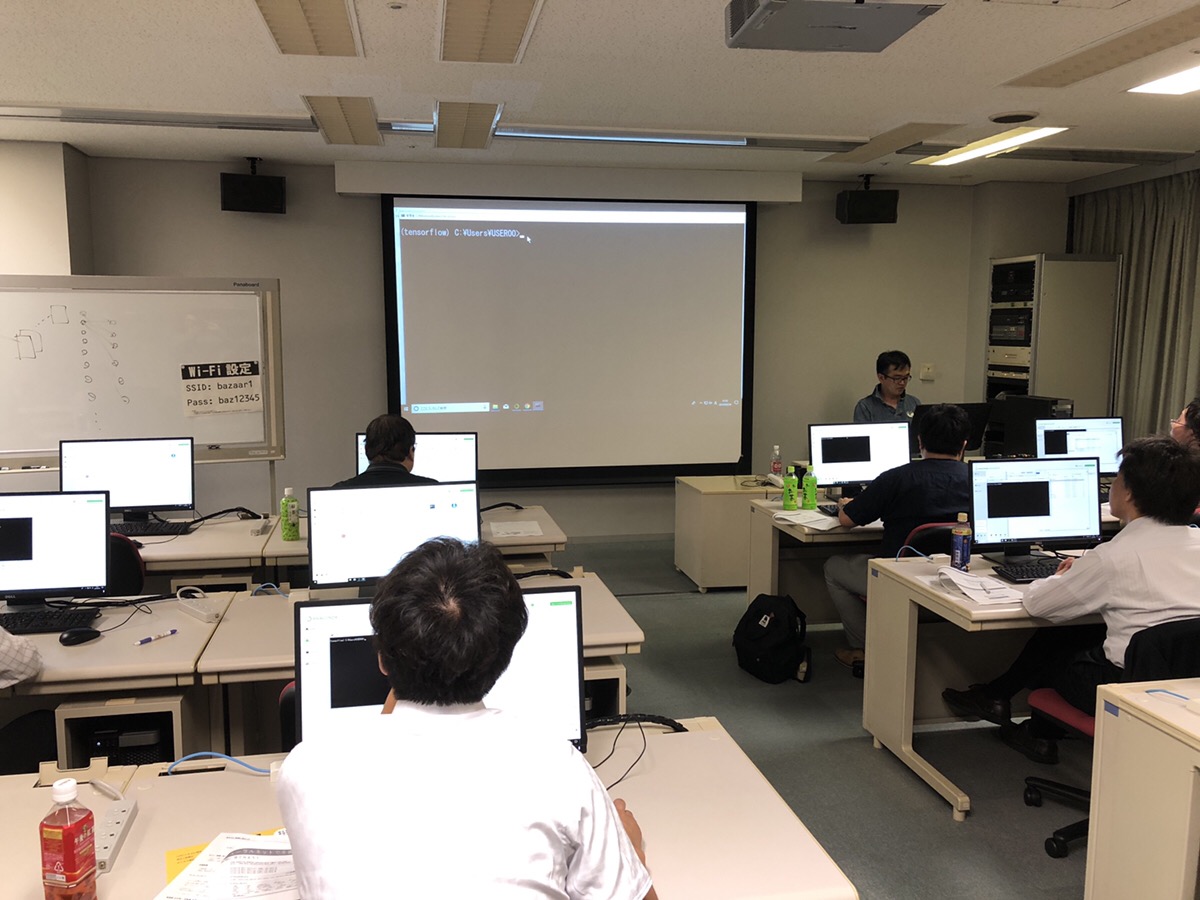

まずは座学的にディープラーニングのしくみを解説いただいて、その後、

実際のソースコードを追いながら、どのように処理を進めていくのかを

解説とコードの実行を繰り返しつつ学んでいきます。

入門セミナーとはいえディープラーニングのしくみ自体が複雑ですので、

ときどき理解が追い付かなくなったりもしますが、

そんな時にすぐその場で質問できるのが、

対面式のハンズオンセミナーのいいところ。

さすがに「ディープラーニングのすべてをつかんだ!」とはいきませんが、

しくみや流れをイメージすることができたので、どんなことに使えそうか、

どういったハードルがありそうか、この先は何を学べばいいのかといったことが

かなりクリアになりました。

ディープラーニングを応用してできることは多岐に渡るので、

また応用編にあたる今後の講座も受講してみようと思います。

次回、予定している早石先生のセミナーは、こちら

↓↓↓↓↓↓↓↓↓↓↓↓↓↓↓↓↓↓

ディープラーニングを応用した画像生成(GAN)のしくみ(2019/12/11(水))

GANとGANから派生した様々なモデルについて、その仕組みの基本を学び、AIで画像を創り出すサンプルプログラムをハンズオンで実際に体験します。

https://techplay.jp/event/758372

おすすめイベント

関連するイベント