【第45回AIセミナー】「日常生活空間で人によりそうAIの活用と課題」

イベント内容

【第45回AIセミナー】「日常生活空間で人によりそうAIの活用と課題」

産業技術総合研究所 人工知能研究センターでは、人工知能研究に関する情報交換を目的として、原則として月に一度、外部の方やセンター内研究者を講師とする人工知能セミナーを開催しています。

2021年1月は特別に2回目として「日常生活空間で人によりそうAIの活用と課題」を行います。

基本的にどなたでも無料でご参加いただけますが、事前申込が必要です。人工知能に興味のある方は奮ってご参加ください。多くの方々にご参加いただき活発な議論が行われることを期待しています。

今回は2番目の講演者・宮下先生以外は英語でご講演をいただきます。同時通訳はありません。

※新型コロナウイルス感染拡大防止のため、今年度はZoomウェビナーによるオンライン開催となります。

イベントURLは参加者だけに表示されますので、口外なさらないようお願いします。

※2021年1月20日 Kruijff-Korbayova, Ivana先生のタイトルが変更されました。

※2021年1月22日 Emmanuel VINCENT先生のタイトルが変更されました。

要旨

少子化と超高齢社会の進行により高齢者の介護や子供の生活安全の支援など、人の日常生活に寄り添って助けてくれるAIの実現に期待が寄せられています。しかしながら、日常空間内での人の生活は人、モノ、人と人の関わり合いなど様々なものが組み合わさって成り立っています。本セミナーでは日常生活という環境における人とAIのインタラクションの先端的な研究と課題を日・米・欧の研究者よりご紹介頂きます。具体的にはリハビリテーションにおけるエンゲージメント、サービス産業にデプロイされたサービスロボットの標準化に係る取り組み、人とAIが日常生活で自然な対話を実現するための課題について紹介します。

基本情報

名称:【第45回AIセミナー】「日常生活空間で人によりそうAIの活用と課題」

日時:2021年1月29日(金) 14:00 - 16:00

接続可能時間:13:50-16:00

場所:Zoomウェビナーによるオンライン開催

(お申し込み後、Doorkeeperより会場URLをご案内いたします。)定員:500名

参加費用:無料

連絡先:人工知能セミナー窓口

注意事項

他の方に参加の機会をお譲りするためにも、参加ができないと分かった場合は早めのキャンセルをお願いします。

産総研は、お送りいただいた情報をセミナー運営以外の目的には使用しません。

講演の録画やアップロードはご遠慮ください。

プログラム

| 14:00- 14:30 |

「AI-enhanced Virtual Reality for Physical Therapy」 Aviv Elor (Department of Computational Media Baskin School of Engineering Ph.D. Student) 概要: Physical therapy can be tedious and often results in lack of engagement, accessibility, and personalization. Immersive media systems enhanced with physical and emotional intelligence can address these challenges. This talk discusses the use of AI-enhanced physical therapy system, complemented with biofeedback, to make physical therapy more enjoyable. The system also provides more immediate feedback to the patients and therapists about therapy progress. 略歴: Aviv Elor is a researcher and Ph.D. candidate from the University of California Santa Cruz studying Computational Media. Aviv's primary research explores how presence can be modeled within immersive virtual reality to maximize a user's flow for a variety of serious applications. This ranges from gamifying medical therapies, designing immersive tools for complex data analysis, and exploring how emerging forms of technology can help stimulate user experience. His goal is to augment serious applications for healthcare to create interactive experiences that are both physically and emotionally intelligent in assisting users. Currently, he has had the opportunity to become a published ACM and IEEE author in this research area, as well as work with organizations like the United States National Institutes of Health, National Science Foundation, Walt Disney Imagineering, Warner Bros Entertainment, Google Daydream, and Valent Power. Aviv is affiliated with the ASSIST Labs at UCSC and is advised by Professor Sri Kurniawan. |

| 14:30- 15:00 |

「ロボットサービスの社会実装に向けたクラウドネットワークロボット(CNR)基盤技術と標準化動向」 宮下 敬宏 (株式会社国際電気通信基礎技術研究所 インタラクション科学研究所・所長) 概要: 人々とのインタラクションを含むロボットサービスを社会実装するために必要となる基盤技術と関連標準化動向について、講演者がこれまで開発してきたクラウドネットワークロボット(CNR)技術を中心に紹介する。 略歴: 株式会社国際電気通信基礎技術研究所(ATR)インタラクション科学研究所長、インタラクション技術バンク長。国立研究開発法人科学技術振興機構(JST)大学発新産業創出プログラム社会還元加速プログラム(SCORE)のプログラムオフィサーなどを兼務。ネットワークロボット技術の研究開発、先端技術の社会実装・社会デザインとともに、数多くのロボット開発を手掛ける。ものづくり日本大賞・優秀賞など受賞。 |

| 15:00- 15:30 |

「Toward lifelong learning for spoken dialog systems」 ※「Continuous Learning from Human-Robot Interactions」より変更となりました Emmanuel VINCENT (フランス国立情報学自動制御研究所 インリアナンシー 主任研究員) 概要: Today's automatic speech recognition and spoken language understanding technologies rely on supervised learning from large amounts of voice data collected from the users and labeled by human operators. This approach (i) raises critical privacy concerns for individual or corporate users, (ii) incurs high costs for voice technology companies, and (iii) does not address under-resourced languages, domains, or categories of users. In this talk, I will describe the methodology adopted in the H2020 project COMPRISE to increase privacy and reduce cost by means of voice anonymization and weakly-supervised learning exploiting the dialog context. These initial steps pave the way toward the long-term vision of a lifelong learning system that would address all of the above shortcomings. I will briefly outline complementary research directions such as online learning and multimodal grounding that shall be investigated to achieve this vision. The research can be effectively used in various speech-based applications, ranging from mobile consumer applications to human-robot interaction. 略歴: Emmanuel Vincent is a Senior Research Scientist with Inria and the Deputy Head of Science of Inria Nancy - Grand Est. His research focuses on deep learning and statistical signal processing for speech and audio, with specific interest on audio source separation and speech enhancement, robust speech and speaker recognition, and privacy-friendly speech technology. He has co-authored more than 200 papers, and received the 2018 ISCA Award for the best paper published in Computer Speech and Language. He has served as the Chair of ISCA’s Special Interest Group on Robust Speech Processing (RoSP SIG), and founded three series of evaluation challenges (CHiME, MIREX, SiSEC). He is currently the coordinator of the H2020 project COMPRISE on cost-effective, privacy-driven voice assistants. |

| 15:30- 16:00 |

「Challenges for situated dialogue processing in robot-assisted disaster response teamwork」 ※「Multimodal information for dialogue processing」より変更となりました Kruijff-Korbayova, Ivana (ドイツ人工知能研究センター 多言語および言語処理技術グループ 主任研究員) 概要: First responders are increasingly using aerial and ground robots for operation at high-risk incident sites. We have been working with first responders for almost a decade to investigate robot-assisted disaster response teamwork in realistic scenarios. With increasing autonomy, robotic systems should become agents capable to actively contribute to a mission. For this they need mission knowledge, i.e., an understanding of the mission as it unfolds, the goals, the tasks within the human-robot team and the state of their execution as the mission progresses. I will present our approach to extract mission knowledge from verbal communication in the robot-assisted disaster response team and discuss some challenges involved in the processing of situated spontaneous spoken and multimodal dialogue in the dynamic and uncertain environments characteristic of disaster sites. My talk is based on current work in the A-DRZ project (Aufbau des Deutschen Rettungsrobotik Zentrums - Setting up the German Rescue Robotics Center; Nov 2018 - Oct 2022; www.rettungsrobotik.de) funded by the German Ministry of Education and Research (BMBF) and on past work in the EU-FP7 projects NIFTi (Natural Human-Robot Cooperation in Dynamic Environments; Jan 2010 - Dec 2013; www.nifti.eu) and TRADR (Long-Term Human-Robot Teaming for Robot-Assisted Disaster Response; Nov 2013 - Dec 2017; www.tradr-project.eu). 略歴: Ivana Kruijff-Korbayová is a senior researcher and project leader in the Multilinguality and Language Technology (MLT) Department of the German Research Center for Artificial Intelligence (DFKI) in Saarbruecken, Germany (www.dfki.de/mlt), where she is leading the Talking Robots Group and the DFKI Competence Center for Emergency Response and Recovery Management. She holds a degree in Electrical Engineering from the Czech Technical University (1992) and a PhD in mathematical linguistics from Charles University, Prague, Czech Republic (1998). 1999-2000 she held a British Academy Visiting Fellowship and a Royal Society / NATO Postdoctoral Fellowship for research in discourse semantics at the University of Edinburgh, U.K. 2001-2010 she held a research position at the Department of Computational Linguistics and Phonetics, Saarland University, Saarbruecken. She has been working at DFKI since 2008. She has experience from many national and international projects. She has published over 70 peer-reviewed papers on various topics in discourse and dialogue modelling and context-sensitive natural language processing as well as human-robot interaction. |

注意事項

※ こちらのイベント情報は、外部サイトから取得した情報を掲載しています。

※ 掲載タイミングや更新頻度によっては、情報提供元ページの内容と差異が発生しますので予めご了承ください。

※ 最新情報の確認や参加申込手続き、イベントに関するお問い合わせ等は情報提供元ページにてお願いします。

お問い合わせ

関連するイベント

【無料】回帰・分類・深層学習の違いが直感的に理解できる!DX時代の常識MLの基本「機械学習超入門」初心者OK

2026/04/25(土) 開催

ネットワークハンズオン(CCNA実習、AWS接続・L3スイッチ・ファイアウォール実習)

2026/04/29(水) 開催

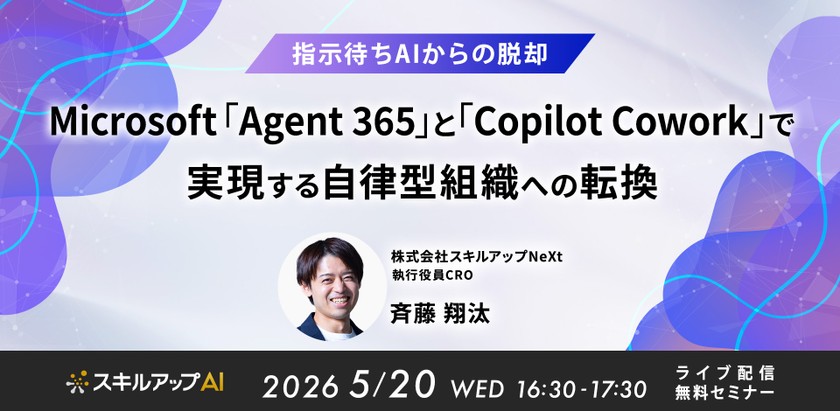

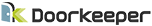

【 GWの4日間で集中学習し、統計検定2級合格を目指す講座】【内容:①4日間のzoom講座(GW開催) +②CBT問題集解説動画(17時間)の視聴と演習 】

2026/05/02(土) 開催

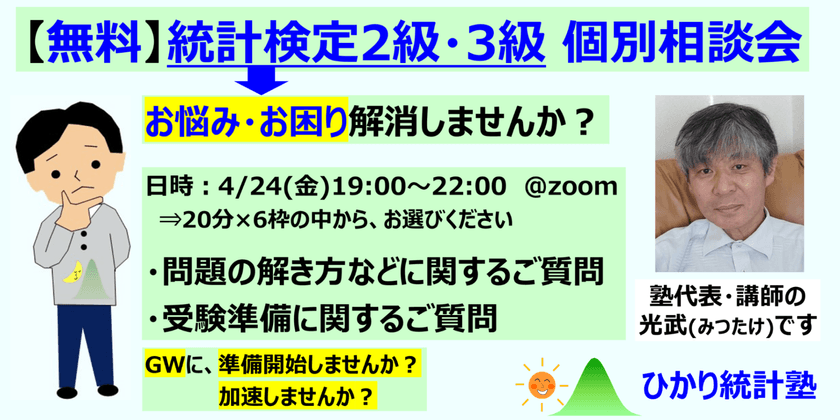

(無料)【統計検定2級・3級を受験される方 対象の個別相談会(zoom開催,1名様20分枠)】対象:基本的な考え方や問題の解き方などに疑問ある方、勉強の仕方などに関してご相談ある方

2026/04/24(金) 開催