Embeddingモデルを使ったベクトル化のしくみ & fine-tuning手法を解説

イベント内容

講座概要

近年、自然言語処理モデルに関する技術が目覚ましく発展し、さまざまなアプリケーションに活用されるようになってきました。

なかでも、文章ベクトル化 (Embedding) は、検索 (Retrieval) タスクやマルチモーダルなモデルへの応用を考える上では欠かせない技術となっています。

ただ、例えばRAGなどでなんとなく文章ベクトル化に触れたことがあっても、その詳しい仕組みまでは分かっていないという人は少なくないのではないでしょうか。

一口に文章ベクトル化といっても、どのようなモデルを使うかであったり、モデルは同じでもどのベクトル化手法を使うかといった要素で、ベクトルの質は大きく違ってきます。 そういったことを大まかにでも分かっておくことは、今後文章ベクトルを利用する際にも非常に有用なのではないでしょうか。

本講座では、自然言語処理モデル (Transformer) を使った文章の埋め込み手法について触れ、また、どのようにモデルをfine-tuningしていくかについて解説していきます。

主な対象者

- RAGを使ったことがある or これから使いたい方

- 文章ベクトル化について知りたい方

前提とする知識

- LLM・AIの基礎知識のある方

- 高校数学の基礎知識のある方

アジェンダ

- Transformerモデルとは

- Transformerモデルを使った文書ベクトル化

- ベクトル化モデルのfine-tuning手法紹介

- まとめ

会場

Zoomウェビナーでの開催となります

※ 参加登録してくださった方に、このページ上部の「参加者への情報」の欄にZoomのURLが表示されます。

タイムテーブル

| 時刻 | 内容 |

|---|---|

| 19:30 | はじめに |

| 19:35 | 講座 |

| 20:20 | 質疑応答 |

| 20:30 | 終了 |

※質疑の内容や数などにより、終了時刻が前後する可能性があります。

発表者プロフィール

東京大学農学生命科学研究科生物・環境工学 修士課程修了。都内のIT企業で自然言語モデルに関わる研究開発に従事。Kaggleメダル獲得数は銀メダル1個、銅メダル2個。

注意事項

※ こちらのイベント情報は、外部サイトから取得した情報を掲載しています。

※ 掲載タイミングや更新頻度によっては、情報提供元ページの内容と差異が発生しますので予めご了承ください。

※ 最新情報の確認や参加申込手続き、イベントに関するお問い合わせ等は情報提供元ページにてお願いします。

お問い合わせ

関連するイベント

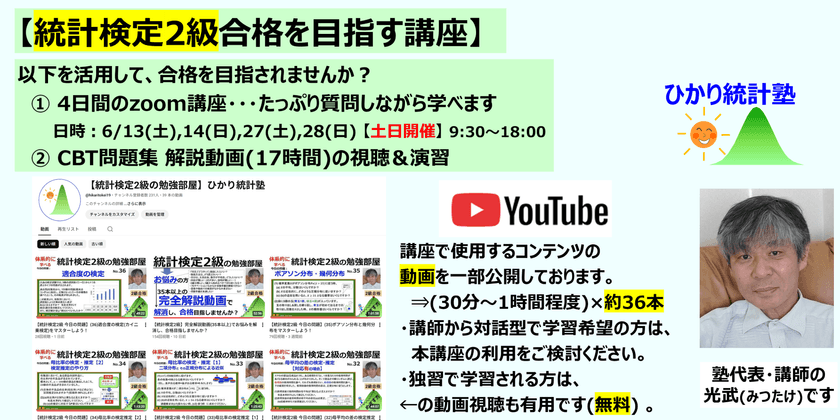

【 統計検定2級合格を目指す講座】【内容:①4日間のzoom講座(土日開催) +②CBT問題集解説動画(17時間)の視聴と演習 】

2026/06/13(土) 開催

【スシローを展開するF&LC様ご登壇!】 AI時代のデータ基盤はこう創る!スシローの実践から学ぶ事業成長を加速させる次世代データ戦略

2026/06/22(月) 開催

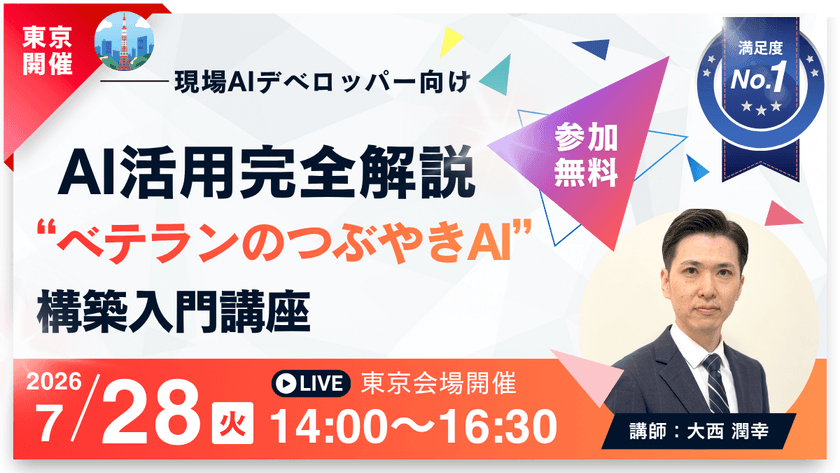

【7月東京開催】ハンズオンセミナー:エクセル1行から始める「ベテランのつぶやきAI」構築のための入門講座(生成AI×技術継承、現場主導のローカルLLM活用)

2026/07/28(火) 開催

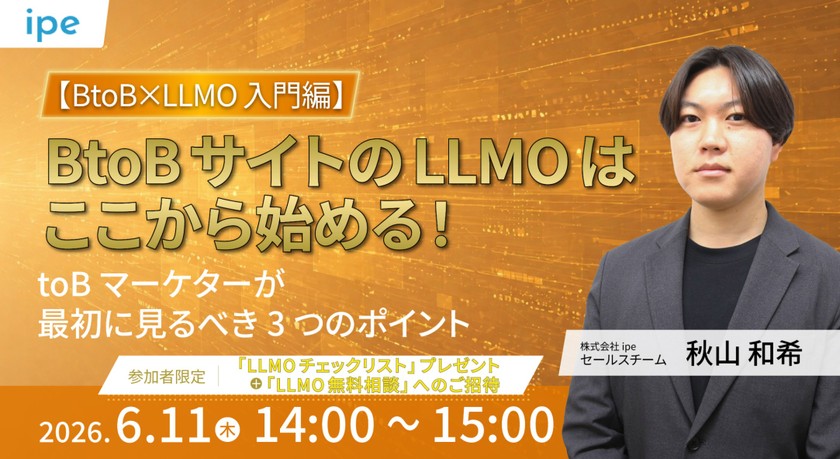

【BtoB×LLMO入門編】 BtoBサイトのLLMO対策はここから始める! toBマーケターが最初に見るべき3つのポイント

2026/06/11(木) 開催