統計

統計(とうけい)は、データの収集、整理、分析、解釈、および表現に関連する学問分野です。統計は、数値データや事実を収集し、それらを整理してパターンやトレンドを見つけ、データの特性や相互関係を分析することを通じて、情報や知識を得るための方法です。

近年、統計は改めて注目されている分野です。そこには以下のような理由があります。

ビッグデータの活用: 近年インターネットやセンサー技術の進歩により、膨大な量のデータが生成されるようになりました。これらのデータはビッグデータと呼ばれ、統計手法を使って分析することで、重要な情報やパターンを抽出することが可能です。ビッグデータの解析には統計手法が欠かせないため、統計への注目も高まっています。

機械学習と人工知能の進歩: 機械学習や人工知能の分野では、統計的手法が広く活用されています。機械学習モデルのトレーニングやパラメータの推定には、統計的手法が不可欠です。また、機械学習モデルの評価や解釈にも統計が重要な役割を果たしています。機械学習と統計の組み合わせにより、データ駆動型の予測や意思決定が可能となり、それに伴って統計への関心も高まっています。

偽情報の検出と信頼性の向上: インターネットやソーシャルメディアの普及に伴い、偽情報やフェイクニュースの問題も増えています。統計手法を使ってデータの信頼性を評価し、偽情報を検出する取り組みが行われています。統計的な手法による信頼性の向上は、情報の正確性と信頼性を高めるために重要です。

経済・社会科学の分野での応用: 経済や社会科学の分野では、統計手法がデータ分析や政策立案に広く活用されています。例えば、経済指標の予測や市場動向の分析、社会調査や人口統計の解析などに統計が欠かせません。経済・社会の理解と問題解決に統計が不可欠であることから、統計への関心も高まっています。

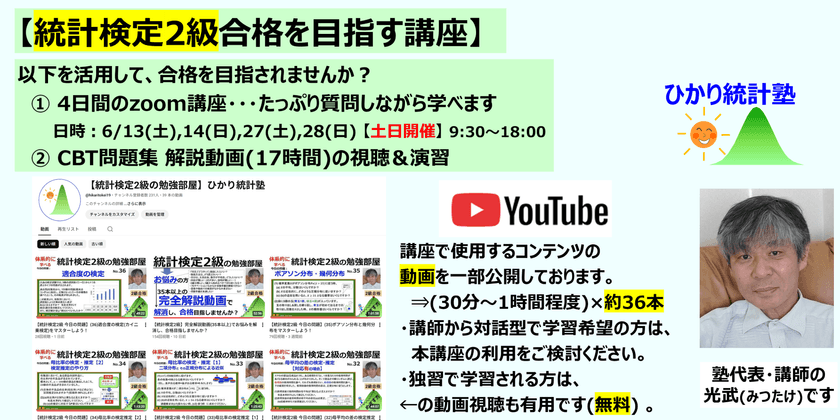

TECH PLAYには統計を学べるイベントやコンテンツが掲載されています。

統計を学んで仕事や学習に役立てましょう。